Seedance 2.0 review: AI video mạnh thật hay chỉ là hype mới?

Nếu chỉ nhìn bề ngoài, Seedance 2.0 rất dễ bị xếp chung với hàng loạt công cụ AI video khác: nhập prompt, thêm ảnh, bấm generate, chờ video xuất hiện. Nhưng nếu nhìn kỹ hơn, đây không chỉ là một “tool tạo clip”, mà là dấu hiệu cho thấy AI video đang dịch chuyển từ giai đoạn demo đẹp mắt sang giai đoạn có tham vọng bước vào pipeline sản xuất nội dung thật.

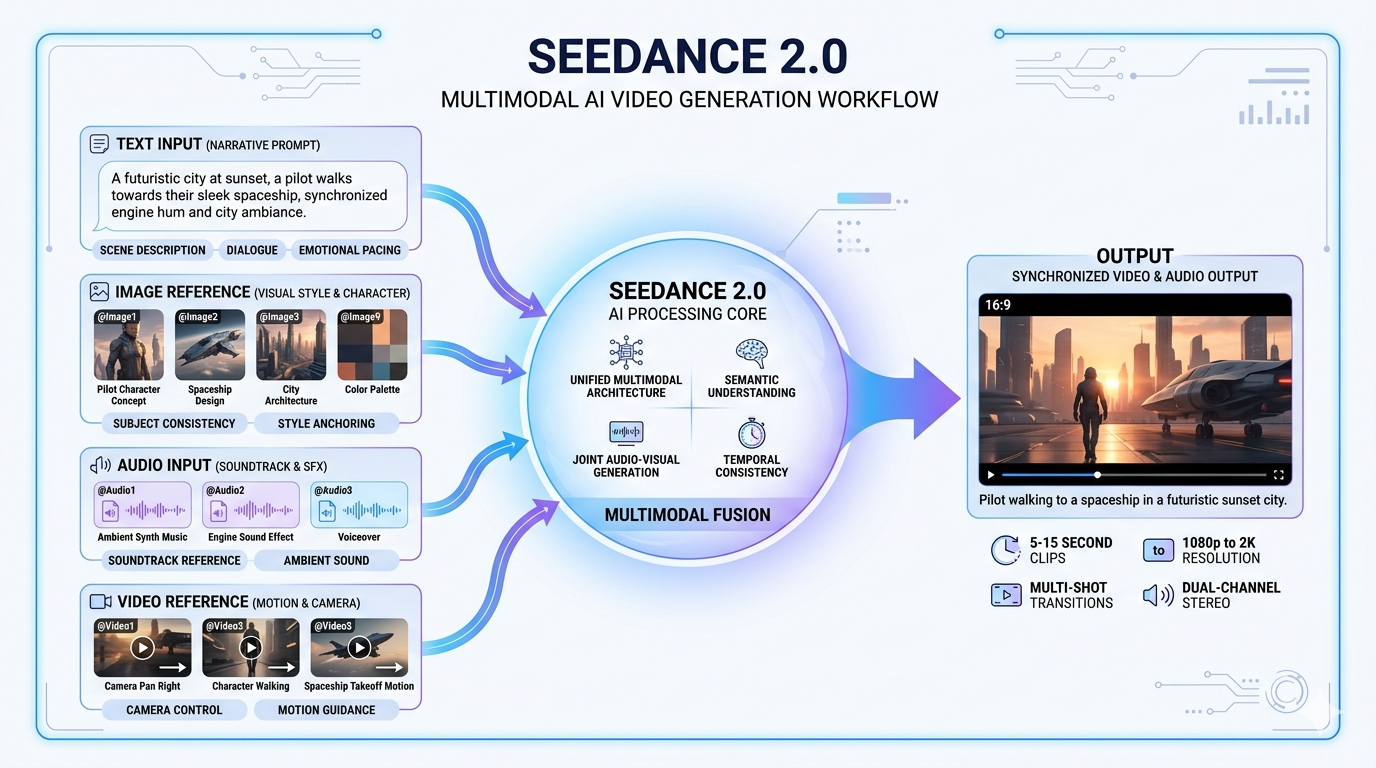

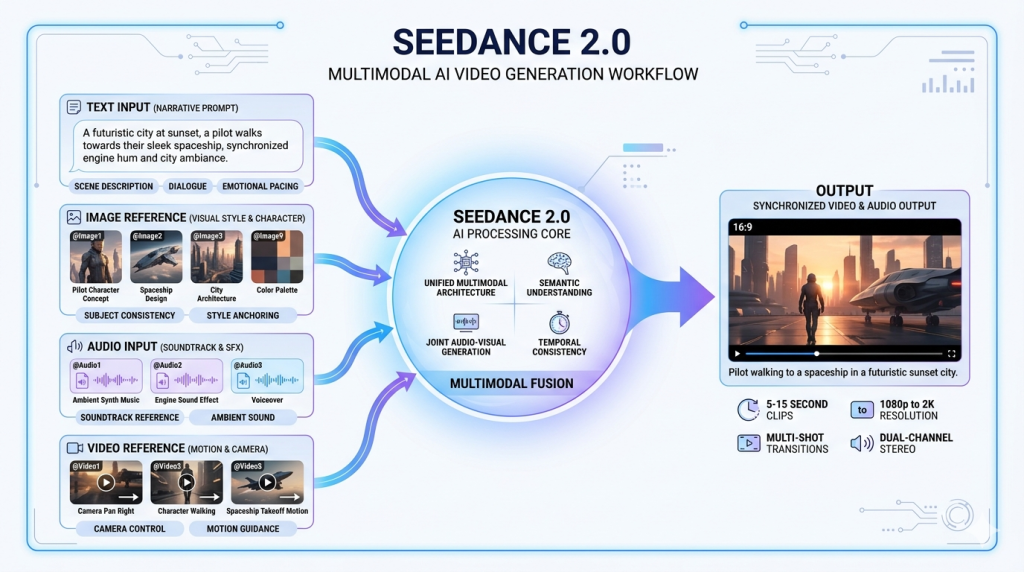

ByteDance Seed công bố Seedance 2.0 vào tháng 2/2026 như một model video thế hệ mới, nhấn mạnh kiến trúc unified multimodal audio-video joint generation. Nói đơn giản hơn, hệ thống này không chỉ nhận text như phần lớn tool đời đầu, mà còn nhận được cả image, audio và video làm input tham chiếu, rồi cố gắng xử lý chúng trong cùng một kiến trúc thay vì tách rời từng bước. Theo công bố chính thức, model hỗ trợ input từ text, image, audio, video; có khả năng tham chiếu và chỉnh sửa đa nguồn; hỗ trợ output clip audio-video tới 15 giây; và cho phép dùng nhiều reference cùng lúc, gồm tới 9 ảnh, 3 video clip và 3 audio clip.

Đây là điểm rất đáng chú ý. Trong phần lớn workflow AI video hiện nay, người dùng vẫn phải chắp vá nhiều công cụ: một model để tạo hình, một model để làm motion, một tool khác để gắn âm thanh, rồi lại hậu kỳ ở editor truyền thống. Seedance 2.0 đang cố giải quyết chính nút thắt đó bằng cách đưa audio và video vào cùng một hệ tạo sinh. Nếu làm tốt, nó không chỉ giúp clip “đẹp hơn”, mà còn giúp giảm một loạt lỗi rất khó chịu như chuyển động không khớp, lip-sync thiếu tự nhiên, hoặc nhịp hình và nhịp âm bị lệch nhau. ByteDance Seed mô tả đây là hướng đi “audio-video joint generation”, còn The Verge cũng ghi nhận model này nổi bật ở khả năng tạo clip 15 giây có âm thanh đồng bộ và hỗ trợ prompt đa phương thức.

Về mặt sản phẩm, điểm mạnh cốt lõi của Seedance 2.0 có thể tóm lại ở ba tầng. Tầng đầu tiên là reference control — tức khả năng lấy nhiều nguồn tham chiếu cùng lúc để giữ nhân vật, phong cách, camera hoặc bầu không khí ổn định hơn. Tầng thứ hai là motion stability — thứ mà ByteDance nhấn mạnh rất mạnh trên trang model card. Tầng thứ ba là audio-native generation — thứ khiến model này trở nên khác biệt hơn nhiều so với kiểu “video trước, âm thanh ghép sau”.

Tuy nhiên, chính ở đây cũng bắt đầu xuất hiện câu hỏi quan trọng nhất của một bài review công nghệ: Seedance 2.0 mạnh trong demo hay mạnh trong sử dụng thật? Đây là hai chuyện hoàn toàn khác nhau. Một model có thể tạo ra những clip benchmark rất ấn tượng trên trang giới thiệu của hãng, nhưng vẫn chưa chắc là công cụ tốt cho creator, agency hay team sản xuất khi phải làm việc với timeline, branding, nhân vật xuyên suốt và deadline thật. Hơn nữa, phần lớn benchmark hiện tại vẫn đến từ hệ sinh thái nội bộ của ByteDance Seed như SeedVideoBench 2.0 và các ví dụ curated bởi chính họ. Điều đó không làm thông tin trở nên vô giá trị, nhưng đủ để người đọc cần giữ một mức dè chừng nhất định khi đánh giá.

Điểm cần nhấn mạnh ở đây là: Seedance 2.0 không hấp dẫn nhất vì nó “tạo video từ prompt”, mà vì nó tiến gần hơn tới một hệ thống sản xuất video đa đầu vào có thể điều khiển được. Đó là lý do nó đáng viết thành một bài review chuyên sâu, thay vì chỉ là bài “có gì mới”.

Từ góc nhìn reviewer, mình sẽ chốt một insight ngay từ đầu: Seedance 2.0 không phải công cụ khiến AI video lần đầu tiên trở nên khả dụng; nó là công cụ khiến người ta bắt đầu nghĩ nghiêm túc hơn về việc AI video có thể chen chân vào production workflow ở cấp độ thật.

Ai cần dùng Seedance 2.0 và ai thì chưa cần?

Không phải ai làm nội dung video cũng cần tới Seedance 2.0. Thực ra, nếu chỉ có nhu cầu tạo vài clip ngắn cho vui, làm visual minh họa đơn giản hoặc thử nghiệm ý tưởng mà không quan tâm quá nhiều tới consistency, thì có nhiều tool dễ dùng hơn. Seedance 2.0 đáng chú ý nhất với ba nhóm người dùng.

Nhóm đầu tiên là creator và team content làm video ngắn nhưng cần scale. Những ai đang làm Shorts, TikTok, Reels hoặc video quảng cáo dạng ngắn sẽ hiểu ngay nỗi đau của việc phải tạo nhiều clip trong thời gian ngắn mà vẫn giữ nhân vật, tone hình ảnh và cảm giác chuyển động đủ nhất quán. Với nhóm này, khả năng reference đa nguồn của Seedance 2.0 có giá trị thực tế hơn hẳn những model chỉ mạnh ở text-to-video thuần.

Nhóm thứ hai là agency / studio / team creative. Ở đây, Seedance không nhất thiết thay thế pipeline hiện có, nhưng nó có thể rút ngắn thời gian prototype concept, dựng previsualization hoặc tạo biến thể nhanh cho nhiều hướng hình ảnh khác nhau. Đây là nơi một model multimodal thường tỏa sáng hơn hẳn so với những tool thiên về “one-click wow effect”.

Nhóm thứ ba là những người đang xây AI content system — ví dụ hệ thống YouTube automation, TikTok automation, marketing content ở quy mô lớn. Với nhóm này, giá trị của Seedance 2.0 không nằm ở từng clip lẻ, mà ở việc nó có thể trở thành mắt xích trong một pipeline lớn hơn.

Ngược lại, ai chưa cần? Nếu bạn là người dùng phổ thông, chỉ muốn một trải nghiệm dễ dùng kiểu nhập prompt là ra kết quả, thì Seedance 2.0 có thể chưa phải lựa chọn hợp lý nhất. Không phải vì nó yếu, mà vì nó đang ở vùng giao thoa giữa model mạnh và workflow phức tạp — tức là muốn khai thác tốt thì cần biết mình đang làm gì.

Nên kết hợp Seedance 2.0 với gì để khai thác đúng sức mạnh?

Đây là phần rất quan trọng mà nhiều bài viết về AI tool thường bỏ qua. Hầu như không có AI video tool nào hiện nay nên được dùng như một giải pháp độc lập hoàn chỉnh. Seedance 2.0 càng như vậy. Nó mạnh nhất khi được đặt trong một hệ công cụ rộng hơn.

Đầu tiên là tool viết kịch bản / scene planning như GPT hoặc Claude. Seedance mạnh về generation, nhưng không thay thế được tư duy dựng cảnh. Một workflow tốt thường bắt đầu từ script → chia scene → xác định reference → generate từng shot → hậu kỳ. Nếu bỏ qua bước scene planning, người dùng rất dễ rơi vào tình trạng prompt dài nhưng video rời rạc.

Thứ hai là tool tạo image reference như Midjourney, DALL·E hoặc các model image khác. Điều này nghe có vẻ ngược đời — dùng AI này để feed cho AI khác — nhưng trên thực tế đây lại là cách làm hiệu quả nhất. Một model video mạnh thường cần “neo” vào hình ảnh tham chiếu nếu bạn muốn giữ nhân vật, costume, góc máy hoặc art direction ổn định giữa nhiều đoạn clip.

Thứ ba là editor hậu kỳ như CapCut, Premiere hoặc DaVinci Resolve. Đặc biệt, TechCrunch ghi nhận ByteDance đã bắt đầu đưa Seedance 2.0 vào hệ CapCut / Dreamina, đồng thời thêm một số lớp bảo vệ liên quan tới khuôn mặt thật và IP. Điều đó cho thấy chính ByteDance cũng đang định vị Seedance không phải như một tool đứng riêng, mà như thành phần của một creative stack lớn hơn.

Nói cách khác, cách dùng đúng của Seedance 2.0 không phải là “mở lên và kỳ vọng nó làm hết”, mà là đặt nó vào giữa pipeline: LLM lo cấu trúc nội dung, image model lo reference, Seedance lo generation có điều khiển, editor lo hoàn thiện.

Cách dùng Seedance 2.0 tối ưu hiệu quả trong thực chiến

Phần lớn người dùng AI video thất vọng không phải vì model yếu, mà vì họ dùng sai kỳ vọng. Với Seedance 2.0, có ba nguyên tắc gần như bắt buộc nếu muốn ra kết quả usable thay vì chỉ “trông khá đẹp”.

Nguyên tắc đầu tiên là nghĩ theo scene chứ không nghĩ theo một prompt dài. Rất nhiều người mới dùng AI video có xu hướng viết một prompt dài, cố nhồi cả cốt truyện, chuyển động, camera, âm thanh, cảm xúc vào cùng một lần generate. Kết quả thường là model hiểu mơ hồ và tạo ra clip có vài khoảnh khắc đẹp nhưng tổng thể thiếu cấu trúc. Cách hiệu quả hơn là chia thành scene ngắn, mỗi scene giải quyết một mục tiêu rõ ràng: shot giới thiệu, shot cận, shot hành động, shot kết. Seedance 2.0 càng phù hợp với cách làm này vì nó mạnh về tham chiếu và continuity cục bộ.

Nguyên tắc thứ hai là ưu tiên reference trước prompt văn hoa. Trong image generation, prompt “cinematic, epic, detailed” đôi khi vẫn giúp được phần nào. Nhưng trong AI video, nhất là với model thiên về controllability, reference gần như giá trị hơn nhiều. Nếu phải chọn giữa một prompt rất đẹp và một bộ reference tốt, bộ reference tốt thường mang lại kết quả hữu dụng hơn.

Nguyên tắc thứ ba là xem Seedance như công cụ tạo “shot” chứ không phải công cụ tạo “video hoàn chỉnh”. Đây là khác biệt rất lớn giữa cách dùng nghiệp dư và cách dùng production. Một shot 5–8 giây tốt, có thể ghép được, có tính ổn định về nhân vật và chuyển động, thường đáng giá hơn nhiều so với một clip dài nhưng lộn xộn.

Insight quan trọng nhất ở phần này là: Seedance 2.0 phát huy mạnh khi người dùng đã chuyển từ tư duy “prompt engineering” sang tư duy “production engineering”. Tức là không còn hỏi “viết prompt gì cho hay”, mà hỏi “thiết kế pipeline nào để ra output ổn định và tái dùng được”.

So sánh Seedance 2.0 với các ứng dụng khác

Đây là phần quan trọng nhất của một bài review vì nó đặt Seedance 2.0 vào đúng bối cảnh thị trường. Một model mạnh không có nghĩa là model phù hợp nhất với mọi người.

So với Runway Gen-3, Seedance 2.0 có vẻ mạnh hơn ở tầng multimodal reference và tham vọng audio-video joint generation. Runway lại có lợi thế rất lớn về giao diện, workflow và hệ sinh thái đã được creator quen thuộc hơn. Nói ngắn gọn: Runway hiện mang cảm giác “sản phẩm”, còn Seedance 2.0 mang cảm giác “động cơ mạnh đang tìm đúng cách đóng gói”.

So với Pika, sự khác biệt nằm ở định vị. Pika phù hợp hơn với creator phổ thông, thiên về tính dễ tiếp cận và tốc độ thử nghiệm. Seedance 2.0 thì ngược lại: rõ ràng nhắm tới nhóm cần nhiều kiểm soát hơn, chấp nhận workflow khó hơn để đổi lấy đầu ra có khả năng dùng trong production tốt hơn.

So với Sora hoặc các đối thủ đang được nhắc tới như Veo, cuộc chơi trở nên thú vị hơn. Theo The Verge, Seedance 2.0 đang được đặt lên bàn cân cùng Veo 3, Sora 2 và các model video mạnh khác. Trong framing đó, Seedance nổi bật ở khả năng prompt đa phương thức và điều khiển, còn Sora thường được nhắc nhiều ở realism / cinematic feel, còn Veo ở sức mạnh tổng quát kiểu flagship. Đây chưa phải cuộc chiến có người thắng tuyệt đối; đúng hơn là các model đang khác nhau ở triết lý: model nào tối ưu cho realism, model nào tối ưu cho control, model nào tối ưu cho productization.

Từ góc nhìn reviewer, so sánh công bằng nhất là thế này: Seedance 2.0 không chắc là tool dễ dùng nhất, nhưng là một trong những tool đáng theo dõi nhất nếu bạn quan tâm đến tương lai của AI video có kiểm soát.

FAQs về Seedance 2.0

Seedance 2.0 là gì?

Đó là model video thế hệ mới của ByteDance Seed, được công bố tháng 2/2026, hỗ trợ input text, image, audio và video trong cùng một hệ multimodal, với tham vọng tạo audio-video đồng thời và kiểm soát tốt hơn bằng reference.

Seedance 2.0 mạnh nhất ở điểm nào?

Mạnh nhất ở khả năng reference đa nguồn, motion ổn định hơn, và việc coi audio là thành phần native thay vì phần hậu kỳ gắn thêm.

Ai nên dùng Seedance 2.0?

Creator chuyên video ngắn có nhu cầu scale, team creative / agency cần prototype nhanh, và những người đang xây pipeline AI content quy mô lớn.

Nên kết hợp Seedance 2.0 với gì?

Nên kết hợp với LLM để viết script, image model để tạo reference, và editor hậu kỳ để cắt dựng, subtitle, pacing và hoàn thiện clip.

Seedance 2.0 có thay editor video không?

Chưa. Nó giảm rất nhiều khâu sản xuất hình ảnh chuyển động, nhưng vẫn chưa thay được công việc dựng, biên tập nhịp, kiểm soát branding và hoàn thiện nội dung ở mức chuyên nghiệp.

Seedance 2.0 có vấn đề gì đáng lo?

Có. Ngoài chuyện chưa chắc trải nghiệm production đã “mượt” như demo, model này còn vướng tranh cãi về nội dung vi phạm IP và tạo hình khuôn mặt / nhân vật không được phép. ByteDance đã công khai nói rằng họ đang tăng cường safeguards, và TechCrunch / The Verge đều ghi nhận đây là chủ đề nóng quanh đợt launch.

Kết luận

Seedance 2.0 không phải kiểu công cụ khiến mọi creator lập tức đổi workflow qua một đêm. Nó cũng chưa đủ để coi là “AI video solved”. Nhưng nếu nhìn dưới góc độ công nghệ, đây là một trong những model hiếm hoi đang đẩy AI video tiến gần hơn tới thứ mà thị trường thực sự cần: khả năng tạo video có kiểm soát, có tham chiếu, có audio đồng bộ, và có thể đặt vào một pipeline sản xuất thật.

Điểm khiến nó đáng chú ý không phải chỉ là benchmark hay chất lượng demo, mà là hướng đi sản phẩm. ByteDance không chỉ muốn có một model “wow”, họ đang cố xây một hệ video creation stack có thể cắm vào CapCut, Dreamina và có khả năng sống trong workflow thật. Đó là dấu hiệu của một cuộc chơi nghiêm túc hơn so với giai đoạn AI video chỉ để gây bất ngờ trên mạng xã hội.

Từ góc nhìn reviewer, kết luận công bằng nhất là: Seedance 2.0 chưa phải công cụ dễ nhất, nhưng là một trong những công cụ quan trọng nhất để theo dõi nếu bạn muốn hiểu AI video sẽ đi về đâu trong 1–2 năm tới.

Insight chốt của bài này là: giá trị thực sự của Seedance 2.0 không nằm ở việc nó tạo ra một clip đẹp hơn đôi chút, mà ở chỗ nó đẩy người làm nội dung từ tư duy “dùng AI như hiệu ứng” sang tư duy “dùng AI như một phần của hệ thống sản xuất”.

#seedance #seedance2 #aivideo #reviewcongnghe #snapsavevn